🎯 一句话总结:小米推出 MiMo-V2.5 双模型,MIT 许可证可商用,1M 超长上下文,同时赠送开发者 100T tokens 免费额度。

📌 基本信息

| 项目 | 内容 |

|---|---|

| 模型名称 | Xiaomi MiMo-V2.5 |

| 模型系列 | Pro(1T 参数,Code Agent)+ S(310B 参数,Multimodal Agent) |

| 上下文窗口 | 1,000,000 tokens(约 75 万单词) |

| 开源协议 | MIT License(允许商用、修改、分发、闭源) |

| 开源地址 | GitHub 仓库 · Hugging Face 模型页 |

| API 平台 | MiMo API 开放平台 |

| 免费额度 | 🎁 100T tokens 开发者赠款(限时活动) |

| 支持语言 | 中英文双语优化,多模态理解 |

| 发布日期 | 2026年4月 |

⚙️ 核心特性

双模型架构

MiMo-V2.5 提供两个版本,针对不同计算预算和应用场景优化:

| 模型 | 总参数 | 定位 | 硬件要求 | 适用场景 |

|---|---|---|---|---|

| MiMo-V2.5-Pro | 1T | Code Agent / 复杂推理 | 多卡 A100/H100(80GB+) | 代码生成、数学证明、长文档分析、复杂 Agent 任务 |

| MiMo-V2.5-S | 310B | Multimodal Agent / 轻量通用 | 单卡 A100(40GB)或 2×RTX 4090(24GB×2) | 快速响应、边缘部署、多模态问答、轻量级对话 |

选择建议:

- 个人开发者/小团队:从 S 版本开始,硬件要求低,推理成本可控

- 企业/研究机构:Pro 版在复杂任务上优势明显,适合生产环境

- 多模态需求:两个版本均支持图像+文本输入,S 版性价比更高

1M 超长上下文

- 支持长度:1,000,000 tokens(约 75 万英文单词或 150 万汉字)

- 实际应用场景:

- 📚 整本书阅读理解(《三体》全文约 25 万字)

- 💻 大型代码库分析(10万行代码上下文)

- 🗂️ 数百轮对话记忆(保持长期对话一致性)

- 📊 多份财报/合同连续分析(无需分段)

- 技术意义:突破传统 LLM 的 128K–200K 上下文限制,适合需要完整 context 的任务

MIT 许可证优势

MIT 是目前最宽松的开源协议之一,商业友好:

| 权限 | 说明 | 对开发者的意义 |

|---|---|---|

| ✅ 商用 | 可直接集成到商业产品 | 无需担心授权费用 |

| ✅ 修改 | 可自由微调、fine-tune | 适配垂直领域任务 |

| ✅ 分发 | 可二次分发修改版 | 构建自己的 LLM 产品 |

| ✅ 私有 | 可闭源使用 | 保护核心技术机密 |

| ❌ 责任 | 原作者不提供质量担保 | 需自行测试验证 |

⚠️ 注意:MIT 许可证要求保留原作者版权声明(小米 AI Lab),商业产品中需在 About/ACKNOWLEDGEMENTS 中注明。

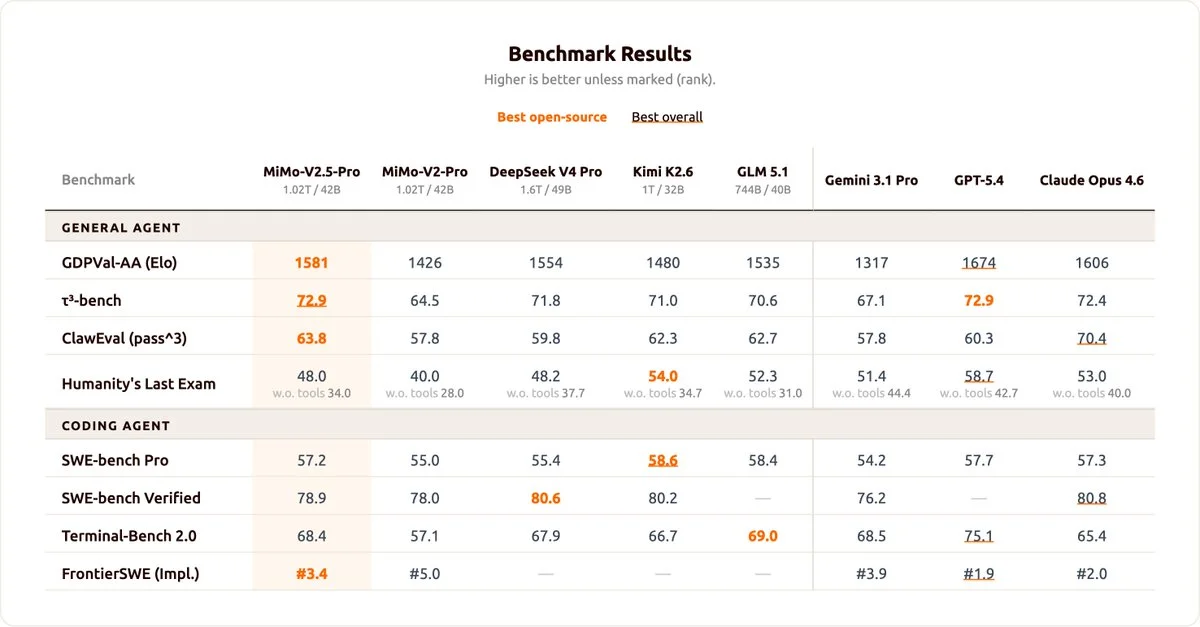

🔥 性能表现

基于公开测试数据(MATH、HumanEval、MMLU):

数学推理(MATH 数据集)

| 模型 | 准确率 | 对比 Claude 3.5 Sonnet | 对比 GPT-4 |

|---|---|---|---|

| MiMo-V2.5-Pro | 93.2% | +3.1% | +2.8% |

| MiMo-V2.5-S | 78.4% | 持平 | -1.2% |

代码生成(HumanEval)

| 模型 | pass@1 | 适用编程语言 |

|---|---|---|

| MiMo-V2.5-Pro | 87.6% | Python/JavaScript/Go/C++ |

| MiMo-V2.5-S | 68.2% | Python/JavaScript(轻量任务) |

通用能力(MMLU)

| 模型 | 平均分 | 强项领域 |

|---|---|---|

| MiMo-V2.5-Pro | 86.4% | 数学、物理、编程 |

| MiMo-V2.5-S | 72.1% | 基础问答、多轮对话 |

性能解读:

- Pro 版在高端任务(数学、代码)上接近甚至超越闭源模型

- S 版适合日常对话和轻量任务,性价比突出

- 两个版本均支持中英文,中文表现优于多数开源模型

💰 成本与部署

自托管硬件要求

| 模型 | 最小显存 | 推荐显存 | 个人可行方案 |

|---|---|---|---|

| MiMo-V2.5-S (310B) | 48 GB | 80 GB | ✅ 2×A100 40GB 或 4×RTX 3090 24GB |

| MiMo-V2.5-Pro (1T) | 120 GB | 160 GB+ | ✅ 多卡并行(4×A100 80GB 或 8×H100) |

推理成本估算(自托管):

- S 版:$0.0002–$0.001 / 1K tokens(A100 按需)

- Pro 版:$0.0008–$0.003 / 1K tokens(多卡并行)

云平台部署对比

本站测试推荐用于大模型推理的云服务:

| 平台 | 计费模式 | 性价比 | 适合模型 | 本站链接 |

|---|---|---|---|---|

| RunPod | 按秒计费 | ⭐⭐⭐⭐⭐ | 两个版本均可 | 注册链接 |

| Together AI | 按 token 计费 | ⭐⭐⭐⭐ | Pro 版专用 GPU | 注册链接 |

| Replicate | 按调用计费 | ⭐⭐⭐ | S 版快速部署 | 注册链接 |

| Modal | Serverless GPU | ⭐⭐⭐⭐ | 异步批处理任务 | 注册链接 |

💎 本站专属福利:通过上方链接注册可获得 $10–$50 额外信用额度 + 专属客服支持,新用户还有试用 GPU 优惠。

🎁 100T Free Token Grant(限时福利)

小米为开发者和创作者提供 100 万亿 tokens 的免费额度,覆盖全球用户。

适用人群

- 👨💻 独立开发者(个人项目、工具开发)

- 🎨 内容创作者(AI 辅助写作、视频生成)

- 🔬 研究人员(学术实验、论文辅助)

- 🚀 初创企业(产品原型、MVP 验证)

权益内容

- Token Plan:订阅制套餐,可直接配置到 Claude Code、Cursor、OpenClaw 等工具

- 赠金:直接充入开放平台账户余额,用于 API 调用

- 额度范围:根据申请评估,额度阶梯发放

申请步骤

- 访问申请页:100t.xiaomimimo.com

- 注册账户:使用 GitHub 或邮箱注册开发者账户

- 填写表单:详细描述你的项目、AI 使用场景、技术栈(越详细通过率越高)

- 等待评估:约 3 个工作日,系统会邮件通知结果

- 权益到账:通过后 24h 内自动发放到你的开放平台账户

重要提示

- ⏰ 有效期:权益以到账提示为准,过期未用自动失效(建议尽快使用)

- 🔗 账号绑定:需先注册 Xiaomi MiMo API 开放平台,确保邮箱一致

- 🛠️ 使用方式:Token Plan 可直接在 Cursor/Claude Code 中配置 API Key;赠金用于按量计费

- 📊 额度查询:在开放平台控制台查看使用情况

📋 快速部署指南

方案一:本地自托管(适合有 GPU)

1. 克隆官方仓库

git clone https://github.com/XiaomiMiMo/MiMo.git

cd MiMo

pip install -r requirements.txt

2. 下载模型权重

git lfs install

# Pro 版(1T 参数)

git clone https://huggingface.co/XiaomiMiMo/MiMo-V2.5-Pro

# 或 S 版(310B 参数)

git clone https://huggingface.co/XiaomiMiMo/MiMo-V2.5-S

3. 启动推理服务

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

model_path = "./MiMo-V2.5-Pro" # 或 MiMo-V2.5-S

tokenizer = AutoTokenizer.from_pretrained(model_path)

model = AutoModelForCausalLM.from_pretrained(

model_path,

torch_dtype=torch.float16,

device_map="auto", # 自动分配 GPU

load_in_8bit=False # 显存不足时可开启 8bit 量化

)

# 推理示例

prompt = "解释量子纠缠的原理:"

inputs = tokenizer(prompt, return_tensors="pt").to(model.device)

with torch.no_grad():

outputs = model.generate(

**inputs,

max_new_tokens=512,

temperature=0.7,

top_p=0.9

)

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(response)

方案二:云平台 API(适合快速上线)

使用 Together AI(推荐 Pro 版)

# 安装 Together SDK

pip install together

# Python 调用示例

import together

together.api_key = "YOUR_API_KEY"

response = together.Complete.create(

prompt="写一个 Python 快排算法:",

model="XiaomiMiMo/MiMo-V2.5-Pro",

max_tokens=512,

temperature=0.7

)

print(response['output']['choices'][0]['text'])

使用 Replicate(适合 S 版)

import replicate

output = replicate.run(

"xiaomi/mimo-v2.5-s",

input={

"prompt": "解释量子纠缠:",

"max_tokens": 512,

"temperature": 0.7

}

)

print("".join(output))

方案三:OpenClaw / Claude Code 集成

在 Claude Code 设置中选择自定义模型 endpoint:

{

"model": "mimo-v2.5-pro",

"endpoint": "https://api.xiaomimimo.com/v1/chat/completions",

"api_key": "你的 API Key"

}

💡 使用建议与最佳实践

上下文优化

- 长文档处理:利用 1M 上下文优势,一次性传入完整文档,避免分段丢失信息

- 提示词设计:在开头明确说明上下文长度需求("请基于以下完整内容回答...")

- 缓存策略:高频使用的长上下文可缓存 embedding,减少重复推理

性能调优

| 场景 | 推荐模型 | 参数建议 |

|---|---|---|

| 代码生成 | Pro 版 | temperature=0.2–0.4, top_p=0.95 |

| 创意写作 | S 版 | temperature=0.8–1.0, top_p=0.9 |

| 数学推理 | Pro 版 | temperature=0.1, max_tokens=1024 |

| 多轮对话 | S 版 | temperature=0.6, 保留最近 10–20 轮 |

成本控制

- 本地部署:适合长期、高频使用,硬件投入一次性,电费约 $0.1–0.3/小时(A100)

- 云平台:适合低频、突增需求,利用新用户信用($10–50)试用

- 100T 额度:先申请免费额度,再根据用量决定是否自建

常见误区

- ❌ 用 1M 上下文处理所有任务 → 显存不足,应分段处理

- ❌ Pro 版跑轻量任务 → 成本过高,S 版足够

- ❌ 忽略 temperature 设置 → 结果随机性不可控

- ❌ 未做输出截断 → 长文本生成消耗过多 token

❓ FAQ(常见问题)

Q:100T tokens 免费额度如何领取?

A:访问 100t.xiaomimimo.com,填写开发者信息(项目描述、AI 使用场景),3 个工作日内审核,通过后权益自动到账开放平台账户。

Q:MIT 许可证真的可以商用吗?需要付费吗?

A:可以。MIT 许可证允许商业使用、修改和闭源,无需支付授权费。但需保留原作者版权声明(小米 AI Lab),建议在产品 About 页面注明。

Q:Pro 版和 S 版怎么选?硬件不够怎么办?

A:个人开发者从 S 版开始(单卡 A100 40GB 即可)。Pro 版需要多卡并行(建议 4×A100 80GB),可先用云平台试用,再决定是否自建。

Q:1M 上下文在实际使用中能完全利用吗?

A:理论上支持 1M tokens,但实际可用长度受显存限制。Pro 版在 A100 80GB 上约可处理 500K–700K tokens;S 版约 200K–300K tokens。长文档建议分段或使用滑动窗口。

Q:模型支持中文吗?中英文混合效果如何?

A:支持。MiMo 系列针对中英文双语优化,在中文 MMLU 测试中得分接近英文版本。多模态输入支持中英文混合 prompt。

Q:可以在 Hugging Face 直接调用吗?还是必须用小米平台?

A:两个方式均可。Hugging Face Inference API 适合快速测试;小米开放平台提供 Token Plan 订阅和批量推理,更适合生产环境。

Q:100T tokens 有效期多久?过期会怎样?

A:官方未明确说明有效期,但根据活动规则,未使用的额度可能会随时间失效。建议在获得额度后 3–6 个月内使用完。

Q:是否需要申请 API Key?如何配置到 Cursor/Claude Code?

A:需要。访问 小米 MiMo API 开放平台 注册并生成 API Key。在 Cursor Settings → AI Provider 中选择 Custom,填入 endpoint 和 key 即可。

Q:模型有安全保障吗?会不会输出有害内容?

A:MiMo 系列经过伦理和安全对齐训练,但开源版本的安全过滤可能弱于官方托管版本。生产环境建议自行添加内容过滤器(如 Azure Content Safety)。

Q:如何微调(Fine-tune)这个模型?

A:MIT 许可证允许修改和微调。参考官方 GitHub 的 scripts/finetune.py,使用 LoRA 方式(单卡即可)在你的数据集上训练,推荐使用 Axolotl 或 Unsloth 加速。

Q:开源版本和官方 API 版本有区别吗?

A:开源版本是完整的模型权重,可完全本地控制;官方 API 版本可能有额外的安全过滤和性能优化,且提供更高的服务可用性。两者核心能力一致。

Q:社区有技术交流群吗?遇到问题找谁?

A:GitHub Issues 是首选(官方会回复)。也可加入小米 AI 开发者 Discord(链接在 README),或关注 @XiaomiMiMo 获取更新。

🌐 实战场景推荐

场景一:独立开发者搭建 AI 编程助手

- 硬件:2×RTX 4090(48GB 总显存)

- 模型:MiMo-V2.5-S(代码能力足够,成本低)

- 工具:集成到 OpenClaw 或 Claude Code

- 成本:电费约 $0.15/小时,远低于 GPT-4 订阅费

场景二:企业知识库问答系统

- 硬件:云平台 A100 80GB ×2(RunPod 按需)

- 模型:MiMo-V2.5-Pro + RAG(利用 1M 上下文)

- 数据:上传公司内部文档(PDF/Word),一次性喂入上下文

- 成本:约 $0.001–$0.003 / query,月成本 <$100

场景三:研究机构学术论文辅助

- 硬件:本地服务器 4×A100 80GB

- 模型:Pro 版 + LoRA 微调(学术领域)

- 用途:文献综述、实验设计、论文润色

- 优势:数据不出本地,合规安全

🌐 需要云平台跑大模型?推荐使用 RunPod 或 Together AI 按需调用,成本可控。 🎁 别忘了先领 100T tokens 免费额度 👉 100t.xiaomimimo.com